Dovremmo Preoccuparci dell’Intelligenza Artificiale Generale?

L’idea di una intelligenza artificiale che superi quella umana è un tema che ha suscitato dibattiti per decenni. Con l’avanzamento degli algoritmi di apprendimento automatico, la possibilità che le macchine possano superare il test di Turing è diventata sempre più concreta. Ma quanto siamo vicini a raggiungere un’intelligenza artificiale generale (AGI) e quali potrebbero essere i rischi associati?

Il Concetto di Singolarità e l’Avanzamento dell’Intelligenza Artificiale

Il termine “singolarità” si riferisce al momento in cui le macchine diventeranno più intelligenti degli esseri umani. Questo concetto è stato oggetto di discussione per molti anni, ma con i recenti progressi nel campo dell’intelligenza artificiale, la questione è diventata più urgente. Gli attuali modelli di intelligenza artificiale si basano su modelli di linguaggio di grandi dimensioni (LLM), che utilizzano dati di addestramento per determinare la parola più probabile da stampare dopo una precedente. Sebbene questi modelli possano produrre risultati ragionevoli, non sono in grado di pensare come un essere umano.

La Differenza tra AI Attuale e AGI

Le intelligenze artificiali attuali sono specializzate in compiti specifici e richiedono dati di addestramento specifici. Tuttavia, l’idea di un’AGI è quella di creare algoritmi in grado di svolgere molteplici compiti, non solo uno singolo, e di farlo al pari degli esseri umani. Anche se la coscienza artificiale potrebbe essere ancora lontana, lo sviluppo di AGI è visto come un passo fondamentale verso questa direzione.

Prospettive Future sull’AGI

Secondo Ben Goertzel, fondatore di SingularityNET, entro il 2029 o il 2030 un singolo computer potrebbe avere la potenza di calcolo di un cervello umano. Aggiungendo altri 10-15 anni, un computer potrebbe raggiungere la potenza di calcolo di tutta la società umana. Tuttavia, ci sono opinioni contrastanti su quanto sia accurata questa previsione. Alcuni esperti, come Geoffrey Hinton, ritengono che l’AGI possa essere raggiunta entro 20 anni, mentre altri, come Yoshua Bengio, sostengono che non sappiamo quanto tempo ci vorrà.

I Rischi e le Preoccupazioni Legate all’AGI

Oltre alle potenzialità, l’AGI porta con sé anche una serie di rischi e preoccupazioni. Uno dei principali timori riguarda l’uso improprio dell’intelligenza artificiale per creare materiale falso e diffondere disinformazione. La creazione di immagini false a scopo propagandistico è già una realtà, e diventerà sempre più difficile distinguere il vero dal falso.

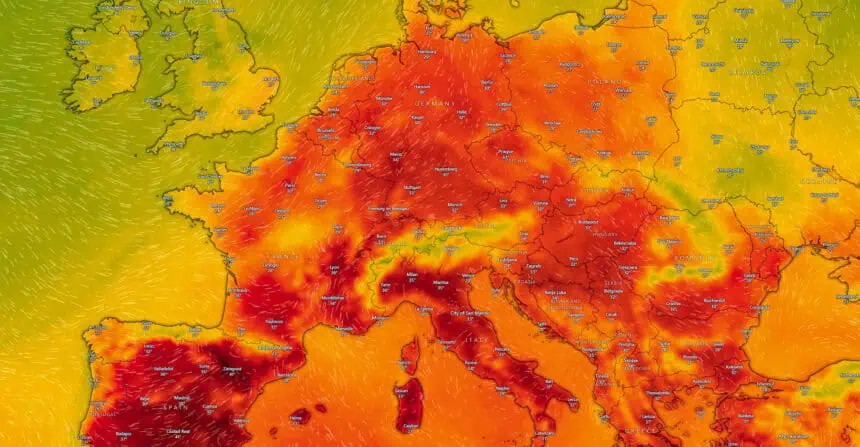

Impatto Ambientale dell’Intelligenza Artificiale

Un altro aspetto critico è l’impatto ambientale delle attuali intelligenze artificiali, che richiedono un uso massiccio di risorse naturali. L’energia necessaria per alimentare questi sistemi è significativa, e con il cambiamento climatico in atto, la situazione potrebbe peggiorare. Le intelligenze artificiali più potenti richiederanno ancora più risorse, aumentando ulteriormente l’impronta di carbonio.

La Necessità di Regolamentazioni

Le regolamentazioni sull’uso dell’intelligenza artificiale non sono ancora state sviluppate in modo significativo, il che rende le preoccupazioni attuali particolarmente rilevanti. Alcuni studi suggeriscono che non dovremmo preoccuparci eccessivamente, poiché la produzione di contenuti di bassa qualità da parte delle AI potrebbe portare a un ciclo di peggioramento continuo, fino a quando l’intelligenza artificiale non diventerà inutile. Tuttavia, è fondamentale stabilire regole chiare per evitare abusi e garantire un uso etico della tecnologia.

mentre l’idea di un’intelligenza artificiale generale è affascinante e promettente, è essenziale affrontare le sfide e i rischi associati. La comunità scientifica e i governi devono collaborare per sviluppare regolamentazioni adeguate e garantire che l’AGI sia utilizzata in modo sicuro e responsabile. Solo così potremo sfruttare appieno il potenziale di questa tecnologia rivoluzionaria, minimizzando al contempo i pericoli che potrebbe comportare.